中小企業がAIを導入する前に整備すべき「データ基盤」とは

中小企業がAIを導入する前に整備すべき「データ基盤」とは

「AIを導入したのに、成果が出ない」——同じ場所でつまずく中小企業の共通点

「ChatGPTを全社で導入したのに、現場の効率化以上の成果が出ません」「RAGを構築して社内データを参照させたのに、全然的外れな回答ばかりです」「AI議事録ツールを入れたが、結局誰もそのデータを活用していません」——AI導入を進める中小企業の経営者から、こうした相談が確実に増えています。

そして実際に現場を見に行くと、こんな状況がほぼ例外なく観察されます。

- 顧客情報が、営業のExcel・名刺管理ツール・会計システム・問い合わせフォームの4箇所に分散している

- 社内マニュアルが、サーバーのフォルダ・SharePoint・個人のローカルPC・印刷物として混在している

- 同じ顧客の表記が「株式会社A」「(株)A」「A」とバラバラで、システム間で名寄せできない

- 過去5年分の契約データはあるが、契約条件・更新日・担当者がエクセルの列名違いで統一されていない

- 業務日報が「自由記述のテキスト」のまま蓄積され、後から検索・集計できる状態になっていない

問題は、AIの性能でも、選定したツールでも、現場社員のスキル不足でもありません。AIに食わせるデータそのものが、AIが扱える状態になっていない——これが本質です。

そして決定的に厄介なのは、この問題がAIを導入するまで気付けない点です。ChatGPTを使い始めて初めて「あれ、社内のデータって、こんなにバラバラだったのか」と気付き、しかし既に予算と期待値は使い果たした後になっている——これが、AI導入で期待を裏切られる中小企業に共通する構造です。

「AIさえ入れれば成果が出る」という前提が、最大の落とし穴です

AI導入が期待外れに終わる最大の理由は、「AIは賢いから、社内のデータをそのまま投げれば良い感じに処理してくれる」という思い込みにあります。残念ながら、AIは魔法ではありません。

AIの精度は、入力されるデータの品質に決定的に依存します。具体的には以下の4つの要素です。

- データが収集されているか——そもそもAIに渡せる形でデータが存在するか

- データが整理されているか——人間が読めるだけでなく、AIが処理できる構造化された形式か

- データが連携されているか——複数のシステムをまたいで、関連データを横断的に参照できるか

- データのガバナンスがあるか——誰が・いつ更新したか、信頼できる情報源かが分かるか

この4つが揃って初めて、AIは中小企業の経営判断や業務改善に貢献できる戦力になります。逆にこの4つが揃っていない状態でAIを導入すると、**「賢そうな返答を返してくるが、内容を見ると実は的外れ」**という最悪の状態が生まれます。

そして決定的に重要なのは、この「賢そうに見えるが的外れ」が、現場の意思決定を歪める点です。明らかに間違った回答なら誰も信じませんが、もっともらしく見える間違いは、現場が信じてしまい、誤った判断を生みます。データ基盤が整っていない状態でAIを導入することは、組織にとって単なる無駄ではなく、積極的にリスクを増やす行為だと認識する必要があります。

この記事で、AI導入前に必要なデータ基盤の整備手順を整理します

本記事では、中小企業がAIで本当に成果を出すために必要なデータ基盤を、以下の5ステップで整備する手順を解説します。

- データの棚卸し——社内に何のデータが、どこに、どんな形で存在するかを把握する

- データソースの統合——分散したデータを集約する仕組みを作る

- データのクレンジングと構造化——AIが処理できる形式に整える

- 連携基盤の構築——複数システムを横断する参照ルートを作る

- データガバナンスの整備——更新責任者・信頼性管理・アクセス権限を整える

各ステップで、中小企業がよく直面する実際の課題と、最小構成で進める具体策を併記します。読み終えた段階で、「来週から自社のどこから手を付けるべきか」が判断できる状態を目指します。

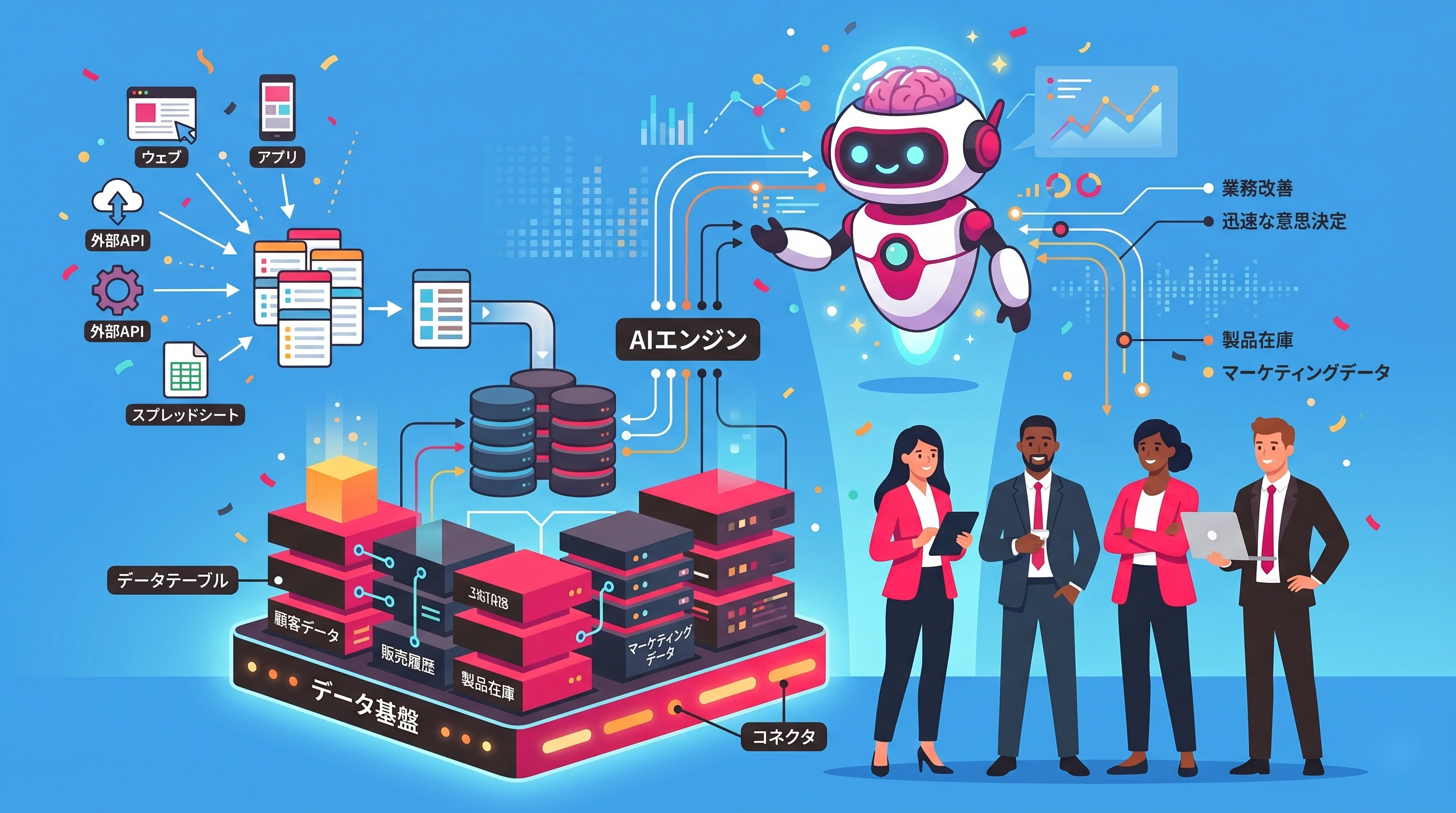

データ基盤を5ステップで整備しAIが成果を出せる土台を作る全体像を可視化した図

データ基盤を5ステップで整備しAIが成果を出せる土台を作る全体像を可視化した図

ステップ1: データの棚卸し——「社内にあるデータの全貌」を把握する

データ基盤整備の出発点は、社内に存在する全てのデータを書き出す作業です。多くの中小企業はこの工程をスキップしてAI導入に進んでしまうため、後工程で破綻します。

棚卸しで書き出すべき4つの情報

データ棚卸しでは、社内のあらゆるデータについて以下の4つを記録します。

- データ名——例: 顧客情報、契約データ、案件管理、業務日報

- 保管場所——例: kintone、Excelファイル、Googleドライブ、紙のファイル

- 更新頻度と責任者——例: 営業担当者が日次更新、経理担当者が月次更新

- データの形式——例: 構造化(テーブル)、半構造化(テキスト)、非構造化(画像・PDF)

棚卸しの粒度は、「業務の単位ごとに1行」が目安です。社員30名規模の企業で、棚卸しの結果が30〜80行程度に収まるのが普通です。100行を超える場合は、粒度が細かすぎる可能性があります。

棚卸しから見えてくる「衝撃の事実」

実際に棚卸しを行うと、ほぼ全ての中小企業で以下の事実が浮かび上がります。

- 同じ情報が3〜5箇所に分散している——顧客情報・取引先情報が典型例

- 重要な情報が個人のPCにしか無い——属人化したExcelファイルやMyドキュメント

- 紙でしか存在しない情報がある——契約書の特記事項、議事録、社内通達

- データの更新責任者が決まっていない——誰でも触れるが、誰も整理しない領域

- 「最新版」がどれか分からないファイルが大量にある——

_v3_確定_最終.xlsx状態

この棚卸しは、それ自体が情報資産の現状把握として価値を持ちます。AI導入の判断材料になるだけでなく、社内の業務プロセス全体の見直しの起点にもなります。

棚卸しを「2週間で終わらせる」進め方

棚卸しは時間をかけすぎると形骸化します。2週間で完了させるのが現実的な目安です。

進め方は以下の通りです。

- 初週前半——各部門から1名ずつ「データ担当者」を任命し、自部門のデータを書き出してもらう

- 初週後半——担当者が書き出した内容を、DX推進担当が統合する

- 2週目前半——統合したリストを元に、各担当者にヒアリングし漏れを補完する

- 2週目後半——優先度(次のAI導入で必要になるか)でランク付けする

この進め方なら、社員30名規模の企業で2週間以内に棚卸しが完了し、次のステップへ進める状態になります。

ステップ2: データソースの統合——分散したデータを「集約する仕組み」を作る

棚卸しが終わると、ほぼ確実に「データが分散しすぎている」現実に直面します。次は、この分散を解消する作業です。

統合の3つの選択肢

中小企業がデータソースを統合する方法は、大きく分けて3つあります。

選択肢1: 既存システムを起点とした統合

業務の中心になっているシステム(多くは販売管理や顧客管理システム)を起点に、他のデータをそこに集約する方法です。たとえば、kintoneを既に使っている企業なら、kintoneを軸に営業案件・顧客情報・契約データを集約します。

長所は、新たなシステム導入が不要で、現場の学習コストが低い点です。短所は、既存システムの能力上限が新たな天井になることです。

選択肢2: データウェアハウス(DWH)を別途構築

BigQuery・Snowflake・Amazon Redshiftのようなクラウド型DWHを別途立て、各システムからデータを集約する方法です。社員規模が100名を超え、複数の業務システムが既に動いている企業に向きます。

長所は、業務システムを変えずにデータ統合ができる点です。短所は、初期構築と運用に専門知識が必要で、月額数万円〜のランニングコストが発生する点です。

選択肢3: ノーコードのデータ連携ツール

ZapierやMakeのようなノーコード連携ツールを使い、システム間のデータを自動的に同期する方法です。社員50名以下の規模で、複数のSaaSを使っている企業に向きます。

長所は、月額数千円から始められ、設定もマウス操作で完結する点です。短所は、複雑なデータ変換には対応しきれず、大量データの処理には不向きな点です。

中小企業が選ぶべき選択肢

社員50名以下の中小企業は、まず**選択肢1(既存システム起点)+ 選択肢3(ノーコード連携)**の組み合わせから始めるのが現実的です。新たなDWHを立てる前に、既存システムの中で何ができるかを徹底的に検討するべきです。

そして、業務拡大とともにデータ量が増え、既存システムの能力が天井に達したタイミングで、選択肢2(DWH構築)に進む——この段階的なアプローチが、中小企業のリスクと投資を最小化します。

統合で陥りがちな罠

統合で最もよく起きる失敗は、**「全てのデータを1つに集めようとする」**ことです。実際には、AIで活用するデータは限定的で、全てを集約する必要はありません。

具体的には、AI導入の最初のフェーズで必要なデータは、社内データのせいぜい2〜3割です。これだけを集約することに集中し、残りは段階的に追加する方針で進めると、統合作業の負荷が大幅に減ります。

ステップ3: データのクレンジングと構造化——「AIが処理できる形」に整える

データを集約しても、そのままではAIに使えません。次は、クレンジングと構造化の作業です。

クレンジングで対処すべき5つの問題

データクレンジングでは、以下の5つを順に対処します。

- 表記揺れの統一——「株式会社A」「(株)A」「A」を1つの表記に統一する

- 欠損値の処理——空欄になっている項目をどう扱うかを決める(埋める・除外する・別のフラグを立てる)

- 重複の除去——同じ顧客・取引が複数回登録されている場合、1つに統合する

- 異常値の検出——明らかに間違っているデータ(金額がマイナス、日付が未来)を見つけて修正する

- 形式の統一——日付形式、電話番号形式、郵便番号形式などをルール化する

これらは地味な作業ですが、ここを怠るとAIの精度は壊滅的に下がります。AIに「株式会社Aの今月の売上」を聞いても、「株式会社A」「(株)A」「A」が別の顧客として認識されていれば、正しい数字は返ってきません。

構造化のポイント

構造化とは、データを「行と列」で整理し、列ごとに型と意味を明確にする作業です。具体的には以下の点を決めます。

- 各列の名前(顧客名・契約日・契約金額など)

- 各列のデータ型(テキスト・数値・日付・選択肢)

- 各列が必須か任意か

- 各列の値が取りうる範囲やルール

特に重要なのは、**「テキストで自由記述されている情報を、できる限り構造化する」**ことです。たとえば「営業日報」が自由記述のテキストだけだと、AIは「先月、株式会社Aを訪問した回数」を答えられません。日付・訪問先・目的・結果を別の列に分離すれば、AIが集計可能なデータになります。

クレンジングと構造化に「AIを使う」

ここで賢いやり方があります。クレンジングと構造化の作業自体に、生成AIを使うのです。

たとえば、以下のような使い方ができます。

以下の顧客名リストを、表記を統一してください。

法人格は「株式会社」「有限会社」など正式表記に統一し、

全角半角は半角に揃えてください。

【リスト】

株式会社A

(株)A

A株式会社

有限会社B

(有)B

...

このようにAIに依頼すると、数千件の表記揺れを数分で統一できます。手作業でやっていた何日もの工数が消えます。**「AI導入のための準備にAIを使う」**という発想が、データ基盤整備のスピードを劇的に上げます。

ステップ4: 連携基盤の構築——「複数システムを横断して参照する」ルートを作る

クレンジングと構造化が終わったら、次は連携基盤の構築です。AIが効果を発揮するためには、複数のシステムにまたがるデータを横断的に参照できる必要があります。

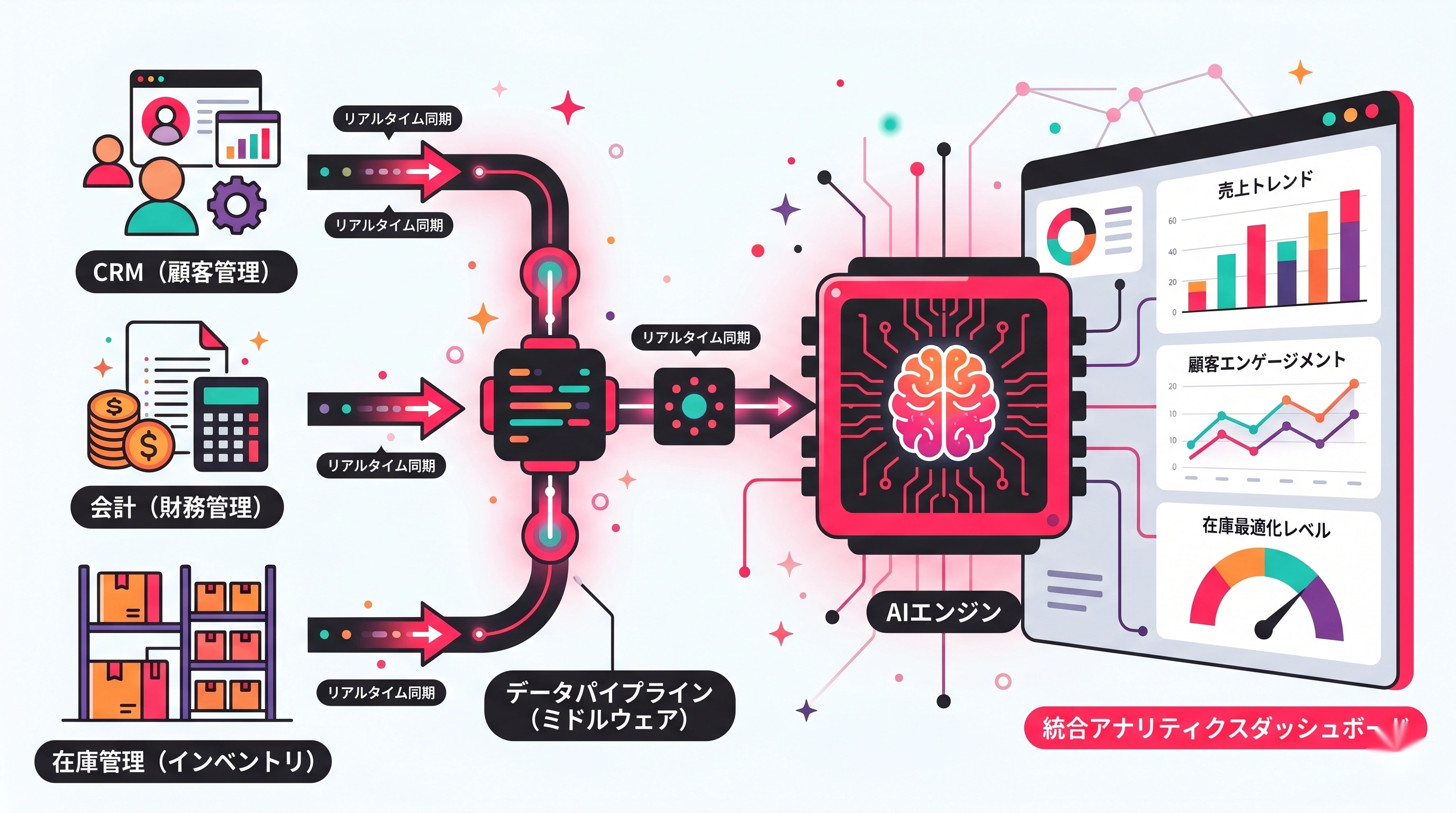

複数システムを横断するデータ連携基盤がAIに統合されたデータを供給する仕組みを表した図

複数システムを横断するデータ連携基盤がAIに統合されたデータを供給する仕組みを表した図

連携基盤が必要な理由

中小企業の業務は、複数のシステムが組み合わさって回っています。営業はCRM、経理は会計ソフト、在庫は管理ソフト、コミュニケーションはSlack——それぞれが独立して動いています。

AIに「先月の利益率が高かった顧客トップ10と、その顧客との直近のやり取り」を聞くには、会計ソフト・CRM・Slack/メールの3つを横断する必要があります。連携基盤がなければ、AIはこの質問に答えられません。

連携の最小構成

中小企業が最初に構築すべき連携の最小構成は、以下の3点です。

- 顧客IDの統一——複数システムで同じ顧客を識別できる共通IDを定義する

- API連携または定期エクスポート——各システムからデータを引き出す手段を確保する

- 集約先の整備——抽出したデータを集約して保管する場所を決める

特に1つ目の「顧客IDの統一」が決定的に重要です。顧客IDが共通化されていないと、システム間で同じ顧客のデータを紐付けられません。顧客IDを統一するだけで、AI活用の幅が10倍に広がると言っても過言ではありません。

ETLとELTの違いと選び方

データ連携の手法には、ETL(Extract-Transform-Load)とELT(Extract-Load-Transform)の2つがあります。

- ETL——抽出後に変換してから集約先に格納する。データ量が少なく、変換ロジックが複雑な場合に向く

- ELT——抽出して集約先に入れた後で変換する。データ量が多く、後から変換ロジックを変える可能性がある場合に向く

中小企業の場合、最初はETL、データ量が増えたらELTという移行が一般的です。最初からELTで始めると、構築工数が大きすぎて挫折する企業が多いからです。

連携の頻度をどう設計するか

連携の頻度は、業務の性質に合わせて決めます。

- リアルタイム連携——必要なケースは限定的。在庫の即時反映など

- 日次連携——大半の業務に対応できる。夜間バッチで翌朝に最新データが揃う

- 週次・月次連携——分析用途で十分なケース

中小企業の場合、まず日次連携から始めるのが現実的です。リアルタイム連携を最初から狙うと、設計と運用の負荷が跳ね上がります。

ステップ5: データガバナンスの整備——「信頼できるデータ」を維持する仕組み

データ基盤が技術的に動き出しても、データの信頼性を維持する運用ルールがなければ、半年で品質が劣化します。最後のステップは、データガバナンスの整備です。

ガバナンスで決めるべき5つのルール

データガバナンスでは、以下の5つを明文化します。

- データオーナー——各データの最終的な責任者を1名指名する

- 更新ルール——いつ・誰が・どんな手順で更新するかを定める

- 品質チェック——定期的に品質を確認する仕組みを作る

- アクセス権限——誰がどのデータを見られる・編集できるかを定義する

- 保持期間——いつまでデータを保持し、いつ削除するかを決める

これらは「決めなくても動く」と思いがちですが、決めないまま走らせると、半年後にデータが信頼できなくなり、AIの回答精度が落ちていきます。

データオーナーの決め方

特に重要なのが、データオーナーの指名です。「みんなで管理する」は実質的に「誰も管理しない」と同義です。

データオーナーは、以下のような形で割り当てます。

- 顧客データ→営業部長

- 契約データ→法務責任者または総務責任者

- 売上・経理データ→経理責任者

- 製品マスタ→製造または商品企画責任者

- 社員データ→人事責任者

ポイントは、「データを最も使う部署の長」をオーナーにすることです。情シスをオーナーにしてしまう企業がよくありますが、情シスは技術的な保守は担えても、データ内容の正しさは判断できません。

品質チェックの自動化

データ品質のチェックは、できる限り自動化します。具体的には以下のような点を機械的にチェックします。

- 必須項目に空欄が無いか

- 日付・金額・電話番号などが想定範囲内か

- 重複登録が発生していないか

- 月次の更新が予定通り行われているか

これらは月次レポートとしてオーナーに自動送信する仕組みを作ると、品質劣化を早期に発見できます。

アクセス権限の最小権限の原則

アクセス権限は、**「業務上必要な最小限の権限だけを付与する」**原則で設計します。

- 営業は自分の担当顧客のみ閲覧・編集可能

- 経理は全顧客の売上情報のみ閲覧可能、編集は経理データのみ

- 経営層は全データ閲覧可能、編集は限定

この最小権限の原則は、情報漏洩リスクの低減だけでなく、誤操作によるデータ破壊の防止にもなります。「全員が全データを編集できる」設計は、中小企業でも避けるべきです。

「自社だけで進めるのが不安」な経営者・担当者へ

ここまで読んで、「AI導入の前に、これだけのデータ基盤整備が必要なのか」と感じる経営者・担当者は多いはずです。実際、データ棚卸しから始めて、ガバナンスまで自社内製で進めると、半年から1年の期間と相応の工数が必要になります。

そして決定的に重要なのは、**データ基盤の整備は「AIを動かすための前準備」ではなく、「自社のDX推進そのもの」**だという認識です。データ基盤が整っていれば、AI以外のDX施策(BIダッシュボード・自動化・予測分析)も同時に動き出します。逆にデータ基盤が無いままAIを入れると、AIだけでなく他のDX施策も全て中途半端なまま終わります。

社内に専任のDX推進部門を置く負担を抑えつつ、データ基盤整備を確実に進めたい場合は、外部の伴走型サービスを活用する選択肢があります。例えば月額制自社DX推進部のようなサブスク型の支援を使えば、データ棚卸しから連携基盤の構築、ガバナンス整備までを月額固定で任せられます。「AI導入の前に、まず土台を作る」——この遠回りに見える進め方が、結果として最短でAIから成果を出すルートになります。

こんな方におすすめです

- AIを導入したのに、思ったような成果が出ていない

- ChatGPTやRAGの利用が、個人の業務効率化止まりで会社全体に波及しない

- 社内のデータが複数のシステムに分散しており、どこから手を付けるべきか分からない

- DX推進を始めたいが、最初の一歩が決められない

- データ管理の責任者が明確でなく、「みんなで管理」になっている

特に**「ChatGPTの利用が個人止まり」**という状況は、すぐ動き出すべきサインです。これは、社員個人がAIの恩恵を実感し始めている一方で、組織としての活用が進んでいないことを意味します。この差が広がると、社員のフラストレーションが蓄積し、優秀な社員が「もっとAIを活用できる会社」へ流れていくリスクが現実化します。

そして決定的に重要なのは、データ基盤の整備は**「やればやっただけ確実に効果が積み上がる」**領域だという点です。AIの最新動向に追従するのは大変ですが、データ基盤は一度整備すれば、AIの世代が変わっても価値が残り続けます。中長期で最も投資対効果が高い領域、それがデータ基盤なのです。

まとめ

データ基盤整備が完了しAIが組織全体で成果を出す未来の姿を表した図

データ基盤整備が完了しAIが組織全体で成果を出す未来の姿を表した図

中小企業がAIで本当に成果を出すためには、AIそのものよりも、その土台となるデータ基盤を先に整備する必要があります。本記事のポイントを整理します。

- データの棚卸し——社内の全データを2週間で書き出し、現状を把握する

- データソースの統合——既存システム起点+ノーコード連携から始める

- クレンジングと構造化——表記揺れ・欠損・重複を整理し、AIに使える形に整える

- 連携基盤の構築——顧客IDの統一+日次連携の最小構成から始める

- データガバナンス——オーナー指名・更新ルール・品質チェック・権限管理を整える

「AIを入れれば成果が出る」という幻想を捨て、**「AIで成果を出せる土台を整える」**という地に足のついた進め方が、結果として最短ルートになります。データ基盤の整備は、AI導入のためだけでなく、自社のDX推進そのものの基礎工事です。ここを丁寧に進めた企業だけが、3年後・5年後にAI活用で本当の差を付けます。

自社単独で進めるのが不安な場合は、外部の伴走者と組むのが最短ルートです。データ基盤整備からAI導入までを月額制で支援する月額制自社DX推進部に、まずは現状のデータ棚卸しから相談してみるのが、成果の出るAI導入への最短ルートです。「AIで何ができるか」を考える前に、「自社のデータがAIに使える状態か」を問い直す——今日が、その問い直しのスタート地点になり得ます。